新聞稿

“领英”(LinkedIn)将于11月3日开始使用用户个人资料训练生成式AI模型 私隐专员公署提醒用户留意相关变更

日期: 2025年10月30日

「领英」(LinkedIn)将于11月3日开始使用用户个人资料训练生成式AI模型

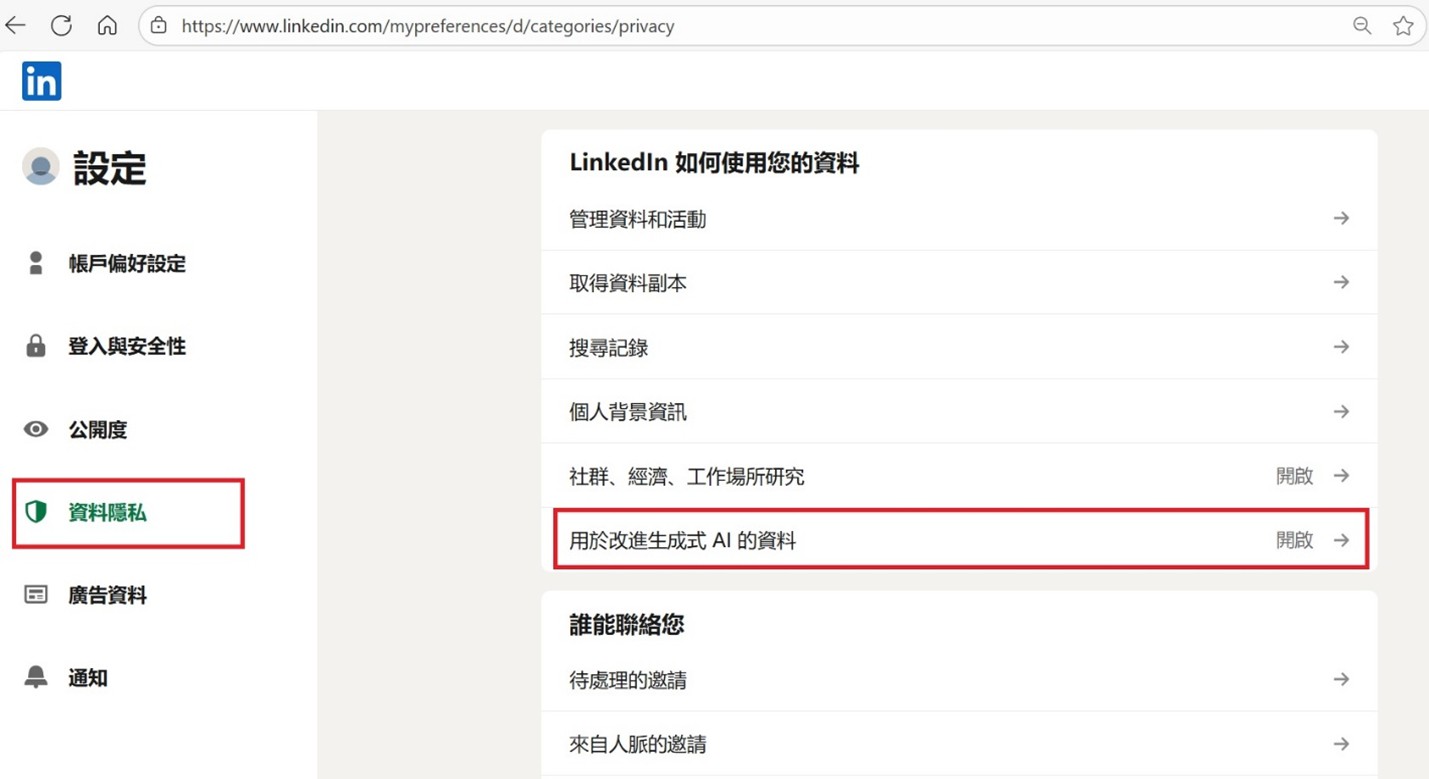

更改使用个人资料训练生成式AI模型的步骤

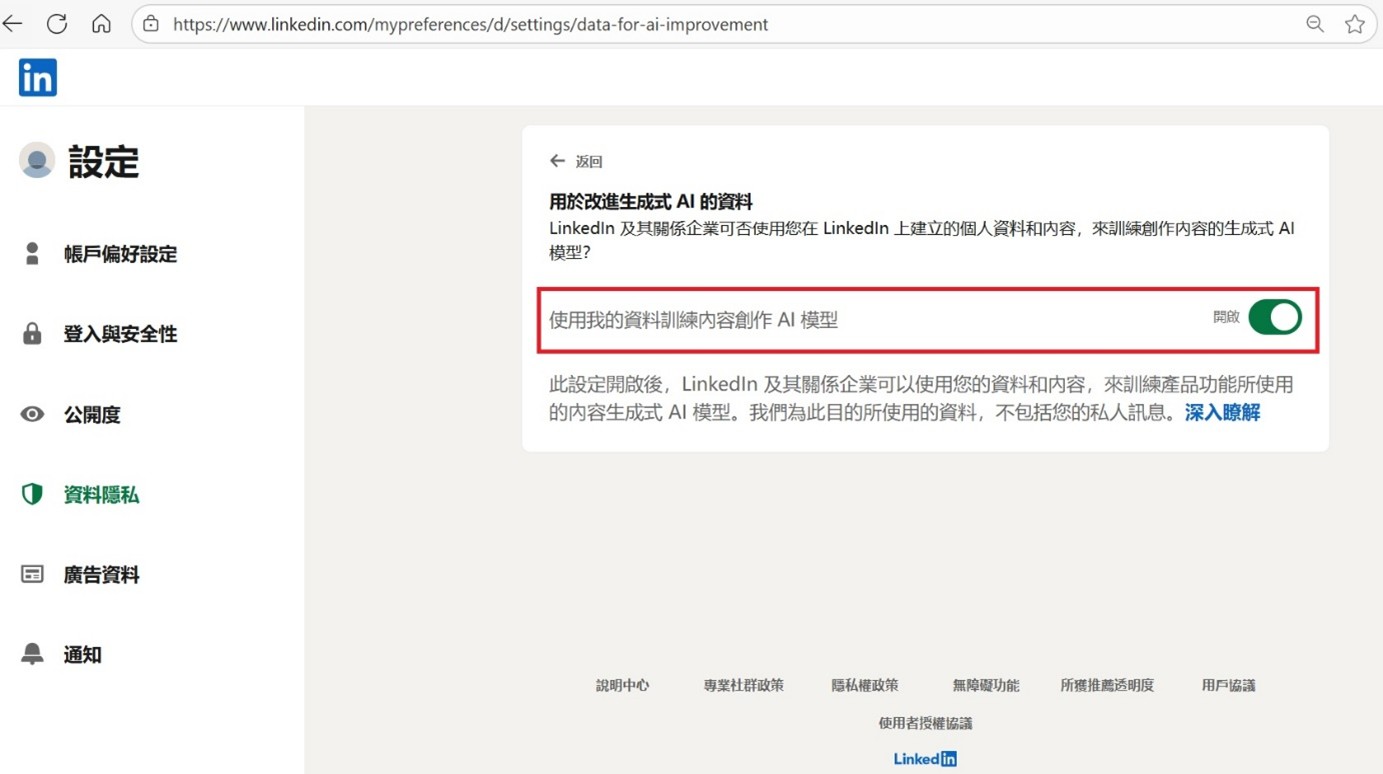

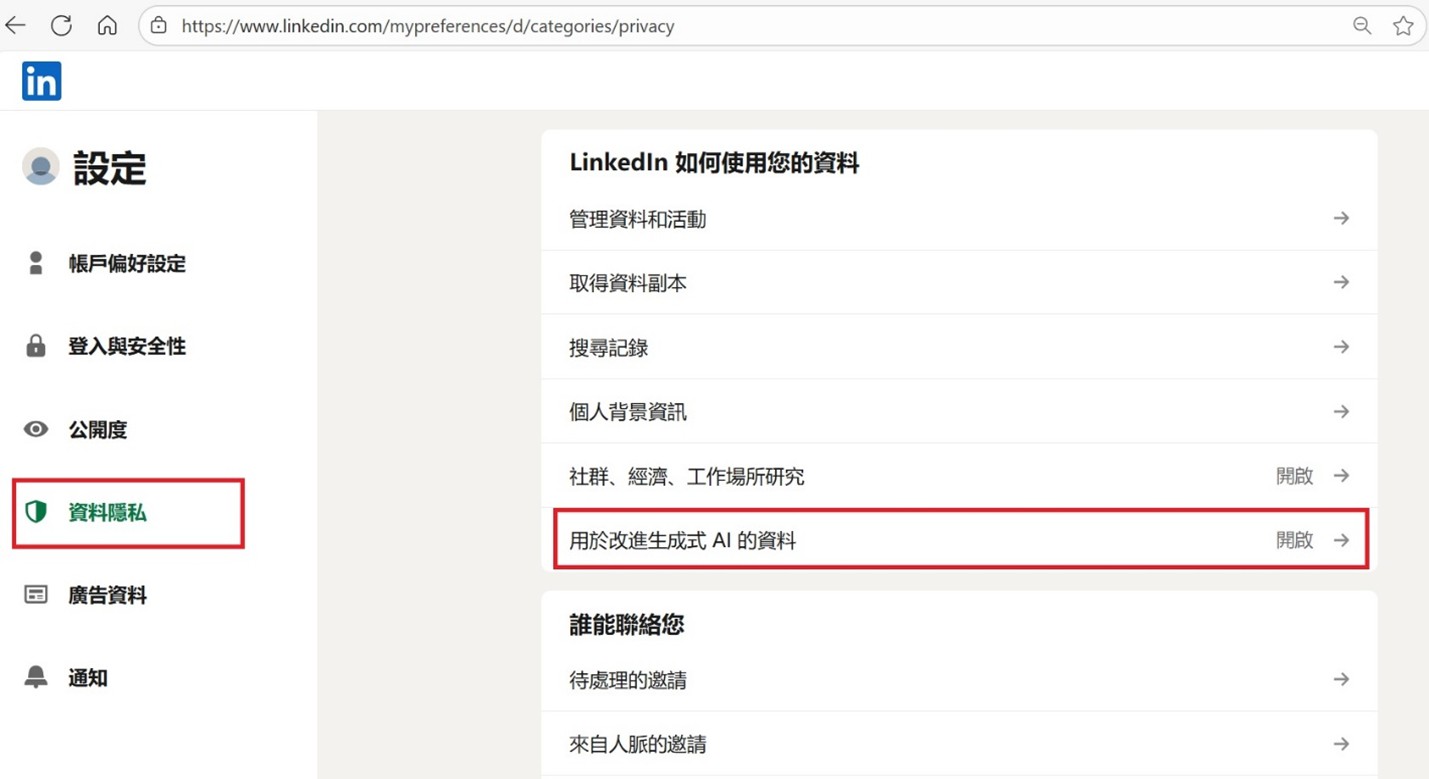

1. 前往帐户设定中的「资料隐私」部分,然后选择「用于改进生成式AI的资料」以找到相关选项。

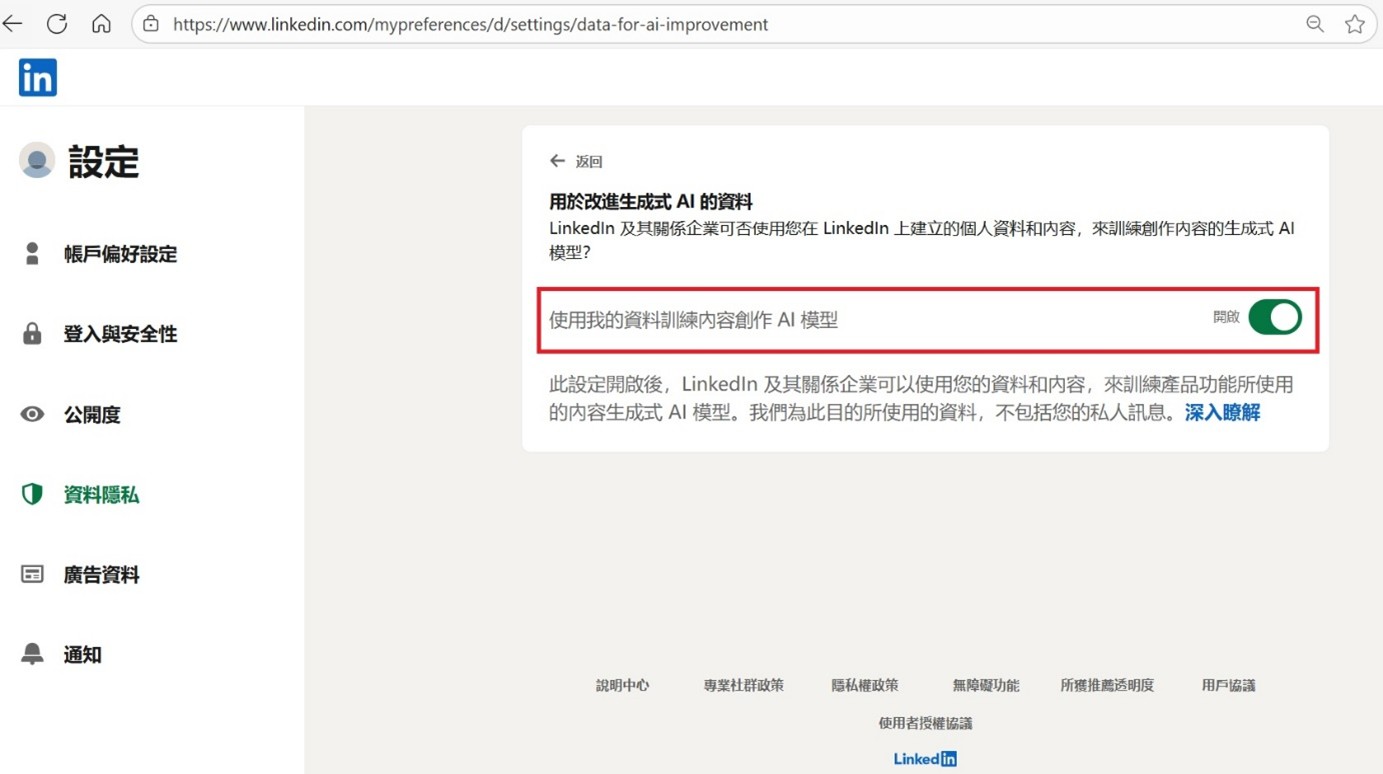

2. 关闭「使用我的资料训练内容创作AI模型」选项以撤销权限。

「领英」(LinkedIn)将于11月3日开始使用用户个人资料训练生成式AI模型

私隐专员公署提醒用户留意相关变更

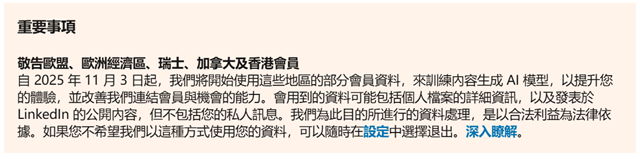

个人资料私隐专员公署(私隐专员公署)留意到职场社交媒体平台「领英」(LinkedIn)于今年11月3日起会开始使用领英用户的个人资料训练其生成式人工智能(AI)模型,相关资料包括用户于平台上的个人档案的详细资讯,以及发表于LinkedIn的公开内容,而领英亦会于同日更新私隐政策,该政策将适用于欧盟、欧洲经济区、瑞士、加拿大及香港用户。

个人资料私隐专员钟丽玲提醒领英用户应留意领英私隐政策的变更,并了解相关政策内容,特别是有关使用用户个人资料训练生成式AI模型的条款,以决定是否同意领英将资料作相关用途。如果领英用户不愿意授权领英使用其个人资料进行生成式AI模型的训练,可按照附件一步骤更改有关预设设定以撤销权限。

领英曾于去年9月中改变私隐政策,使领英可以使用用户在平台上的个人资料和内容来训练生成式人工智能模型创作内容。其后因私隐专员公署介入,领英自2024年10月11日暂停使用香港用户的个人资料作上述用途。公署于去年10月至今年4月期间,一直就事件向领英了解相关情况,并审视其建议的细节,领英承诺香港用户对使用其个人资料以训练生成式AI模型拥有自主控制权,并确保相关安排符合《个人资料(私隐)条例》的规定。

私隐专员公署已向领英提供保障个人资料私隐的建议,并将继续监察有关情况,以确保香港用户的个人资料私隐获得保障。

此外,在国际层面,为应对个人资料被用作训练AI模型的趋势,公署早前于环球私隐议会年度会议与其他私隐保障机构共同发起《收集、使用及披露个人资料作预先训练、训练及微调AI模型决议》,重申使用个人资料作训练AI模型须遵守相关法律及保障资料和私隐原则,以及加强跨境执法合作等,该决议于会议上获得130多个议会成员一致通过。

个人资料私隐专员钟丽玲提醒领英用户应留意领英私隐政策的变更,并了解相关政策内容,特别是有关使用用户个人资料训练生成式AI模型的条款,以决定是否同意领英将资料作相关用途。如果领英用户不愿意授权领英使用其个人资料进行生成式AI模型的训练,可按照附件一步骤更改有关预设设定以撤销权限。

领英曾于去年9月中改变私隐政策,使领英可以使用用户在平台上的个人资料和内容来训练生成式人工智能模型创作内容。其后因私隐专员公署介入,领英自2024年10月11日暂停使用香港用户的个人资料作上述用途。公署于去年10月至今年4月期间,一直就事件向领英了解相关情况,并审视其建议的细节,领英承诺香港用户对使用其个人资料以训练生成式AI模型拥有自主控制权,并确保相关安排符合《个人资料(私隐)条例》的规定。

私隐专员公署已向领英提供保障个人资料私隐的建议,并将继续监察有关情况,以确保香港用户的个人资料私隐获得保障。

此外,在国际层面,为应对个人资料被用作训练AI模型的趋势,公署早前于环球私隐议会年度会议与其他私隐保障机构共同发起《收集、使用及披露个人资料作预先训练、训练及微调AI模型决议》,重申使用个人资料作训练AI模型须遵守相关法律及保障资料和私隐原则,以及加强跨境执法合作等,该决议于会议上获得130多个议会成员一致通过。

领英将更新私隐政策(撮要)

-完-

附件一

环球私隐议会《收集、使用及披露个人资料作预先训练、训练及微调AI模型决议》(只有英文版)

https://globalprivacyassembly.com/wp-content/uploads/2025/10/Resolution-on-the-collection-use-and-disclosure-of-personal-data-to-pre-train-train-and-fine-tune-AI-models.pdf

https://globalprivacyassembly.com/wp-content/uploads/2025/10/Resolution-on-the-collection-use-and-disclosure-of-personal-data-to-pre-train-train-and-fine-tune-AI-models.pdf

-完-

更改使用个人资料训练生成式AI模型的步骤

1. 前往帐户设定中的「资料隐私」部分,然后选择「用于改进生成式AI的资料」以找到相关选项。

2. 关闭「使用我的资料训练内容创作AI模型」选项以撤销权限。